Türerkennung, Live-Untertitel und mehr

Apple kündigt fortschrittliche Bedienungshilfen an

Apple nimmt den am 19. Mai stattfindenden „Global Accessibility Awareness Day“ zum Anlass, eine Reihe von Softwarefunktionen im Bereich Bedienungshilfen anzukündigen, die die Leistungsfähigkeit von Hardware, Software und maschinellem Lernen kombinieren. Noch in diesem Jahr will Apple mithilfe von Softwareupdates unter anderem eine Türerkennung für blinde und sehbehinderte Menschen, die Möglichkeit zur Steuerung der Apple Watch vom iPhone aus und die Anzeige von Live-Untertiteln für Gehörlose und Schwerhörige einführen.

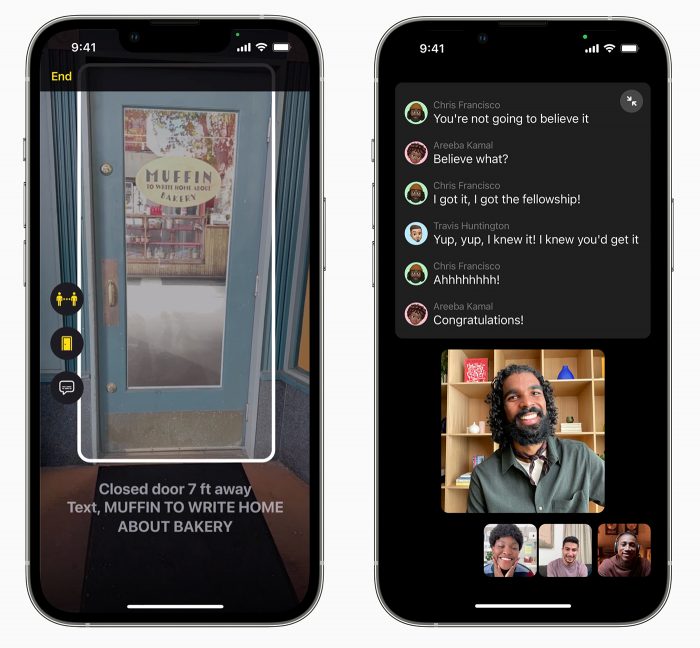

Türkerkennung

Die Türerkennung für blinde und sehbehinderte Menschen ist eine erweiterte Navigationsfunktion, die mithilfe der in neueren iPhone- und iPad-Modellen verbauten LiDAR-Sensoren, der Kamera der Geräte und maschinellem Lernen realisiert wird. Im Erkennungsmodus kann die neue Funktion nicht nur vor Türen warnen, sondern liefert neben dem aktuellen Zustand – geschlossen oder geöffnet – auch umfassende Details, etwa zur Beschriftung und ob sie sich durch Drücken oder Drehen eines Kaufs öffnen lässt. Die dafür genutzte Lupen-App kann dabei unter anderem Aufschriften wie Öffnungszeiten oder eine Zimmernummer erfassen und vorlesen.

Finger- und Handgesten

Menschen mit körperlichen und motorischen Einschränkungen profitieren von erweiterten Funktionen zur Bedienung der Apple Watch. „Apple Watch Mirroring“ ermöglicht es, die Uhr mithilfe der auf dem iPhone verfügbaren unterstützenden Funktionen wie Sprachsteuerung und Schaltersteuerung zu steuern. Dabei können Sprachbefehle, Geräuschaktionen, Head Tracking oder externe „Made for iPhone“-Hilfen als Alternative zum Tippen auf dem Bildschirm der Uhr verwendet werden. Als zusätzliche Möglichkeit zur Bedienung der Apple Watch werden künftig sogenannte „Quick Actions“ zur Verfügung stehen, durch ein zweifaches Zusammendrücken der Finger oder dem Ballen der Faust kann man dann beispielsweise einen Anruf annehmen oder beenden, eine Benachrichtigung abweisen, ein Foto aufnehmen und mehr.

Live-Untertitel

Auf Menschen mit Hörproblemen sind die von Apple angekündigten Live-Untertitel ausgerichtet. Hier wird quasi eine Live-Abschrift von Audioinhalten angezeigt, die Funktion ist Apple zufolge unabhängig von der genutzten App verfügbar und kann auch während Gesprächen verwendet werden. Auf dem Mac gibt es ergänzend dazu die Möglichkeit, eine Antwort einzutippen und diese in Echtzeit laut aussprechen zu lassen. Apple weist darauf hin, dass die Untertitel auf dem Gerät selbst generiert werden und somit keine Daten das iPhone verlassen.

…und weitere Funktionen

Darüber hinaus hat Apple noch die folgenden Neuerungen im Bereich der Bedienungshilfen angekündigt – wir kopieren den Originaltext aus der Pressemitteilung ein:

- Mit Buddy Controller können Nutzer:innen eine:n Betreuer:in oder Freund:in bitten, ihnen beim Spielen zu helfen. Buddy Controller kombiniert zwei beliebige Spielecontroller zu einem, so dass mehrere Controller die Eingabe für eine:n einzelne:n Spieler:in steuern können.

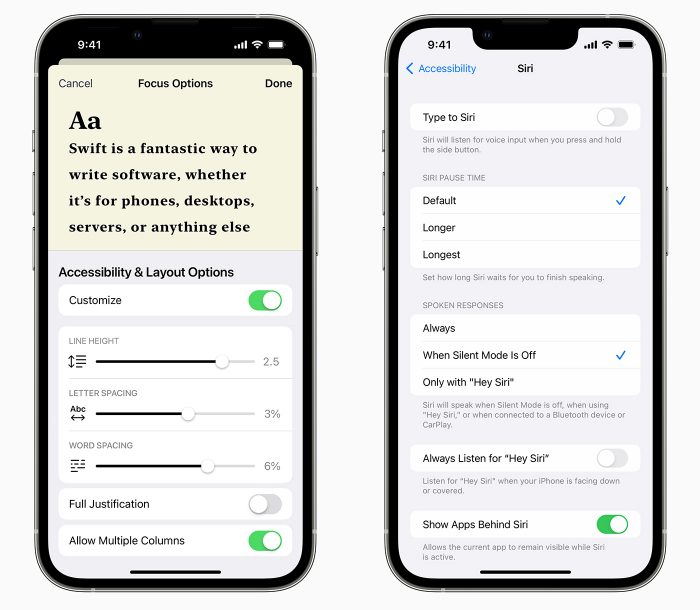

- Mit Siri Antwortzeit können Anwender:innen mit Spracheinschränkungen einstellen, wie lange Siri wartet, bevor sie auf eine Anfrage antwortet.

- Der Rechtschreibmodus der Sprachsteuerung bietet Nutzer:innen die Möglichkeit, benutzerdefinierte Schreibweisen durch buchstabengenaue Eingabe zu diktieren

- Die Geräuscherkennung kann so angepasst werden, dass sie Geräusche erkennt, die speziell für eine Person in ihrer Umgebung wichtig sind, beispielsweise ein bestimmter Alarm, die Türklingel, ein weinendes Baby oder Geräte in der Wohnung.

- Die Apple Bücher App wird neue Themen anbieten und Anpassungsoptionen einführen, wie beispielsweise das Anzeigen von Text in Fettschrift und das Anpassen von Zeilen-, Zeichen- und Wortabständen, um ein noch zugänglicheres Leseerlebnis zu ermöglichen

Das hört sich nach iOS 16.0 bzw 16.1 an ;-)

Hätte man auch gut auf der WWDC ankündigen können:)

Ob das bedeutet, dass es zur wwdc so viel gibt, dass das hier die speak time überschritten hätte? :-O

Ich denke das wird bewusst jetzt gemacht da sowas gerne untergeht in den restlichen Ankündigungen, gut ankommt bei der Presse, aber dennoch keine großen Geheimnisse kaputt macht

War ja bei der watch auch so gehandhabt worden mit den Bedienungshilfen

Am 19.5. ist Global Accessibility Awareness Day, deswegen diese Ankündigungen zu diesem Tag glaub ich. Finde ich eine gute Gelegenheit, statt alles immer in eine WWDC zu packen und dann nicht mehr den Überblick haben was alles neu ist. So hat man an mehreren Tagen was zu freuen, gell?

Klingt spannend. Vor allem das mit der Türklinke ist echt cool.

Spannend wäre es zudem, wenn alte Technik wie Siri endlich mal was können würde.

Spannend ist es zudem, dass es immer etwas zu kritisieren gibt anstatt einfach mal den Fortschritt in den Bedienungshilfen positiv zu betrachten.

Passt

Das mit dem Controller budy wär was um mit meinem sohn mal was zu spielen, oder Single player doch zu zweit spielen können :D sehr nice!

Fas mit siri könnte sich auch noch lohnen für mich xD ich als schwizer habe manchmal recht grosse Denkpausen wo dann siri einfach die lust verliert zuzuhören, lol

Ist echt schlimm zu lesen dieses gender konforme Geschreibe dieses Nutzer:in oder bediener:innen tut so krass in den Augen weh