Vorerst nur englischsprachig

Google Lens: Die Pixel-Funktion kommt auf das iPhone

Der Suchmaschinen-Betreiber Google wird seine intelligente Foto-Auswertung, die als Alleinstellungsmerkmal der Pixel-Smartphones im November 2017 lancierte Funktion „Google Lens“ demnächst auch auf anderen Android-Telefonen und auf dem iPhone anbieten.

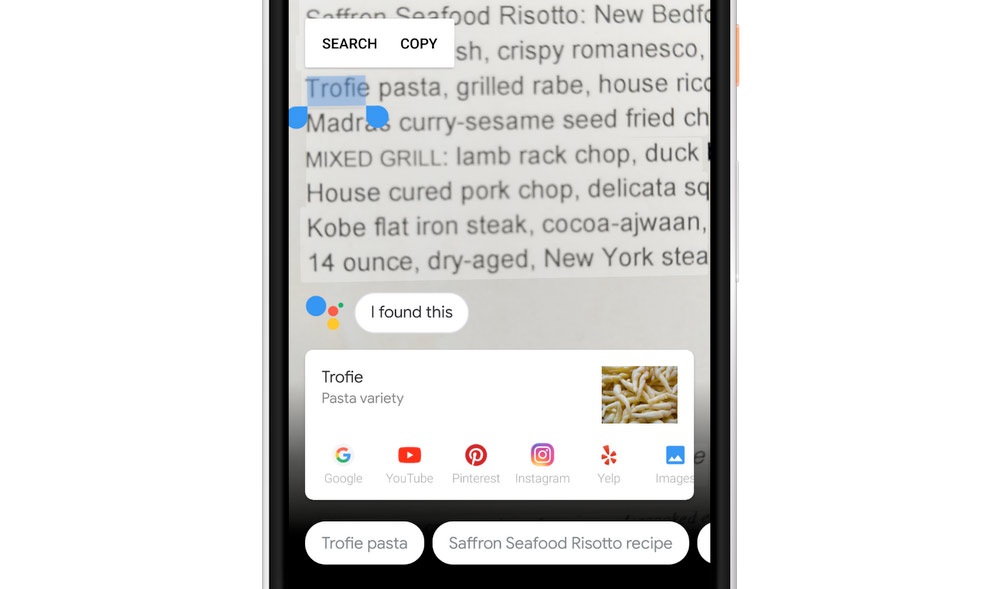

Google Lens startete als Erweiterung für Googles Siri-Konkurrenz, den sogenannten Google Assistent, und kombinierte mehrere Foto-Funktionen, die durch maschinelles Lernen und intelligente Bildauswertung deutlich bessere Ergebnisse liefern sollten, als die bereits am Markt verfügbaren Produkte.

So kann Google Lens nach Informationen in bereis aufgenommenen Motiven suchen, Visitenkarten Scannen, Internetadressen folgen, Telefonnummern wählen oder Navigationsziele eingeben.

Google Lens versteht sich zudem auf das Erkennen von Barcodes und QR-Codes, soll beim Entdecken neuer Umgebungen zur Hand gehen indem Sehenswürdigkeiten identifiziert und historische Infos automatisiert abgerufen werden und kann abfotografierte Filmposter, Bücher und Kunstwerke um ausführliche Infos zum Maler und Autor bzw. um einen Film-Trailer ergänzen.

Funktionen, die fortan auch auf dem iPhone über Googles offizielle Fotos-App abrufbar sein sollen:

Mit Google Lens kann eure Smartphone-Kamera helfen, die Welt um euch herum besser zu verstehen. In den kommenden Wochen erweitern wir daher die Verfügbarkeit der Preview-Version. Mit Google Lens in Google Fotos könnt ihr mehr Informationen über die Inhalte eurer Fotos erhalten. Google Lens steht für alle Nutzer der englischsprachigen Version von Google Fotos mit der neuesten Version der App auf Android und iOS zur Verfügung. In den kommenden Wochen können Nutzer der englischsprachigen Version auf kompatiblen Geräten ebenfalls das kamerabasierte Google Lens im Google Assistant erleben. Schon bald werden wir weitere Geräte unterstützen.

Soetwas hätte ich auch von Apple schon länger erwartet.

Kommt, Apple braucht da immer so seine Zeit, kennt man ja

Also mir wird übel, wenn das bedeutet, dass damit ja noch viel viel mehr Informationen aus meinem Privatleben zu Google wandern. Gescannte Visitenkarten? Telefonnummern? Sind die gescannten oder angerufenen Leute auch damit einverstanden, dass das alles über Googles Server läuft.

Schauder….

Das musst du mit den Leuten abklären, nicht Google. Schließlich gibst DU Google die Daten.

Hast du jeden deiner Kontakte gefragt, ob du ihre Telefonnummer/Kontaktdaten auf Apples Servern speichern darfst? Und mit einen der anderen Anbietern teilen, welche auf das Adressbuch zugreifen dürfen?

Exakt. Wenn ich da schon an alle Leute denke, die Facebook und WhatsApp nutzen und den Zugriff auf ihre kompletten Kontakte erlaubt haben. Vielen Dank, ich wurde nicht gefragt!

Genau das mein ich, und aus genau diesen Gründen tu ich das auch nicht (weil es praktisch unmöglich ist, alle zu fragen). Es ist meines Erachtens nach übrigens auch ein Verstoß gegen die Datenschutzgesetze, es ohne Einverständnis der Betroffenen zu machen. Und nein, ich unterscheide nicht zwischen Google, Apple, WhatsApp und Co. in dieser Sache.

Spyware by Google

Wo ist in der App auch nur andeutungsweise das zu finden, was im Video gezeigt wird?

musste die englische version installieren. geht via vpn bzw tunnelbear app